目前研究团队承担的科研项目:

- 国家自然科学基金,提高多视点视频编码效率的技术研究(60772050),2008-2010。

- 国家自然科学基金,基于码流的网络视频无参考质量评估方法研究(60902081),2010-2012。

- 中芬国际合作项目,未来移动通信泛在业务与应用研究(2010DFB10570),2010-2012。

- 陕西自然科学基金,多视点视频压缩算法研究(SJ08F03),2008-2010。

- XX公司合作项目, UMTS系统视频传输QoE研究,2011-2012。

- XX公司合作项目,视频通信技术合作,2011-2013。

- XX公司合作项目,HiMEMC 算法技术合作,2012-2014。

- XX公司合作项目,多媒体质量评估及处理技术研究项目,2011-2013。

- XX公司合作项目,高性能多帧图像融合方法研究与实现,2012-2013。

- XX公司合作项目,HEVC编码算法/解码模型技术合作项目,2012-2014。

- XX公司合作项目,VP9 Codec PV模型合作项目,2013-2014。

- XX公司合作项目,QoE以及图象处理技术研究项目,2013-2015。

- Google research project,Optimization for vp9 coder under computatioal complexity constraint, 2015-2016.

- XX公司合作项目,VP9实时编码器优化项目,2014-2016。

- XX公司合作项目,隔逐行电影源检测技术合作项目,2015-2016.

- 国家自然科学基金,通信生态系统中DASH视频业务QoE评估研究,2016-2020.

- XX公司合作项目,视频通话MOS标准研究,2016-2017.

- XX公司合作项目,VR编码与传输系统, 2017-2018.

- XX公司合作项目,VR多视角QoE, 2017-2018.

- XX公司合作项目,QUIC视频传输质量研究与空口优化技术, 2017-2018.

- XX公司合作项目,vMOS ITU-T 标准化研究,2018-2019.

- XX公司合作项目,六自由度VR, 2018-2020.

- XX公司合作项目,vMOS(P.QUIT) ITU-T 标准化研究,2018-2020.

- XX公司合作项目,VR体验标准化研究,2018-2020.

- XX公司合作项目,未来视频标准技术合作项目,2019-2020.

- XX公司合作项目,cloud VR用户体验智能评测系统,2019-2020

- XX公司合作项目,基于视点追踪的VR视觉显示系统,2019-2020

- XX公司合作项目,云VR系统平台,2020-2021

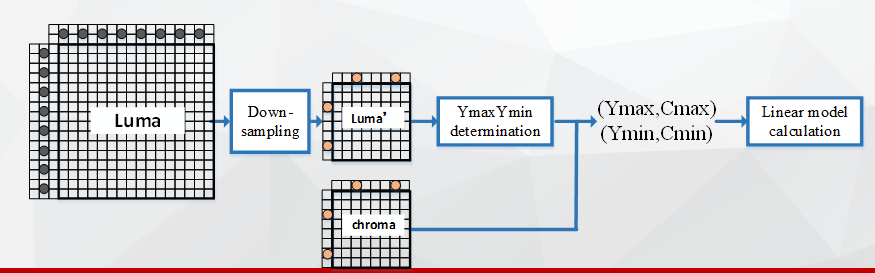

- XX公司合作项目,Efficient Prediction between Chroma and Luma components for AV2,2020-2021

- XX公司合作项目,基于深度学习的视频优化,2021-2022

- XX公司合作项目,基于深度学习的联合率失真优化,2021-2022

- XX公司合作项目,VVC高性能快速算法,2021-2022

- XX公司合作项目,自由视角视频体验评估,2021-2022

- XX公司合作项目,互联互通流媒体传输,2022-2023

- XX公司合作项目,自未来视频标准技术,2022-2026

- XX公司合作项目,VVC高性能快速算法2,2022-2023

- XX公司合作项目,云游戏视频优化算法,2023-2024

多媒体通信实验室属于ISN国家重点实验室,长期从事图像和视频编码、处理和多媒体通信研究。主要合作对象包括华为、OPPO、阿里、小米、Google、三星、高通、大唐、联永等。课题组和华为技术公司建立了长期合作关系,2005年成立了西电-华为多媒体通信联合实验室。

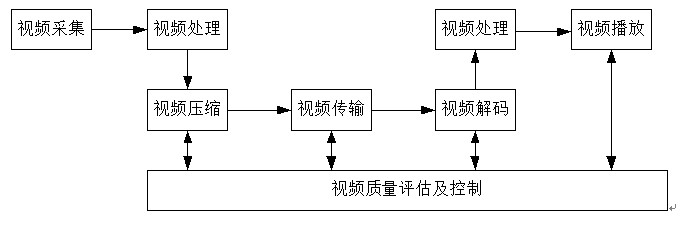

主要研究领域包括:视频采集、视频处理、视频压缩、视频传输、视频质量控制、视频播放等多媒体通信的所有环节。

目前重点研究方向:新一代视频压缩标准、基于深度学习的视频处理、虚拟现实VR

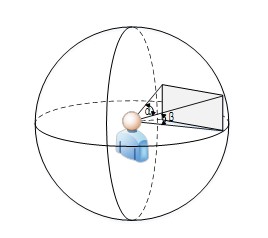

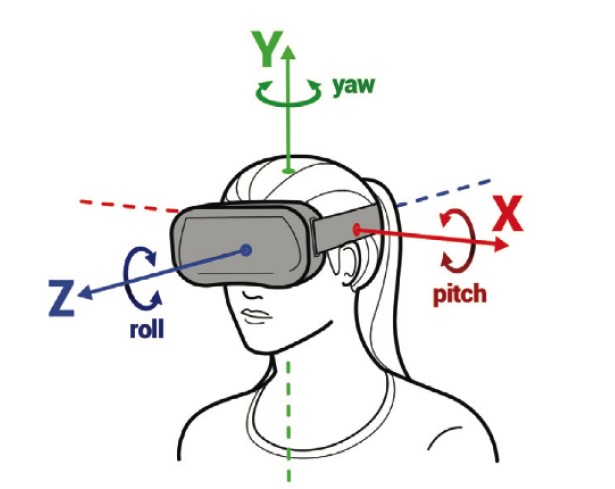

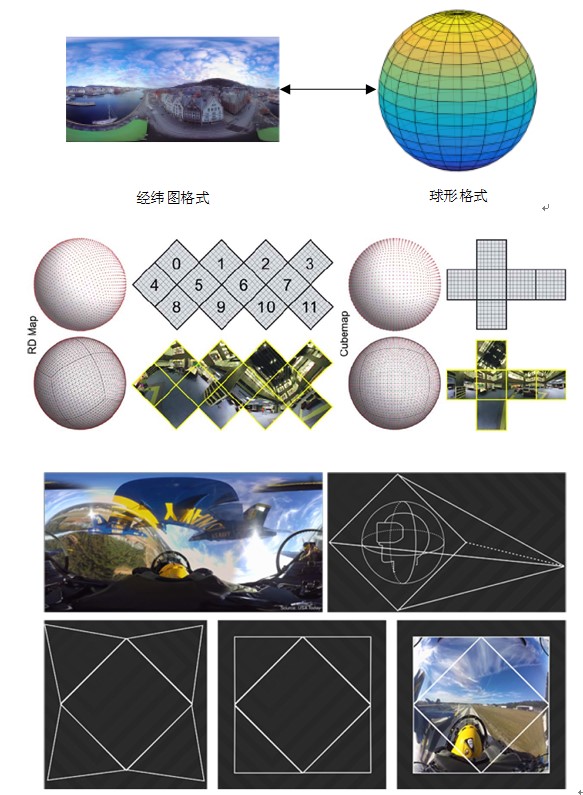

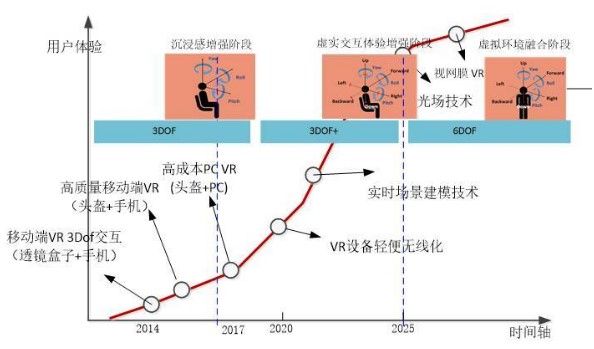

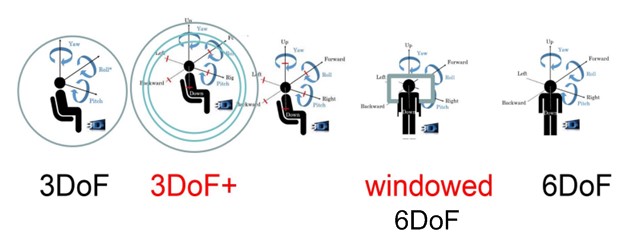

1、3DOF——360全景视频

360度全景视频是环绕某个中心点的球形视频,其原理如图2所示。在VR应用中,360视频以观看者为中心,利用HMD准确跟踪到观看者的头部运动信息,HMD实时显示360视频相应的视角区域,为观看者提供了360度的自由观看视角,使用户获得良好的临场感(Presence)体验。360度全景视频可以匹配用户的三个运动自由度(3DOF),如图3所示。

图2 360视频示意图

图3 3DOF

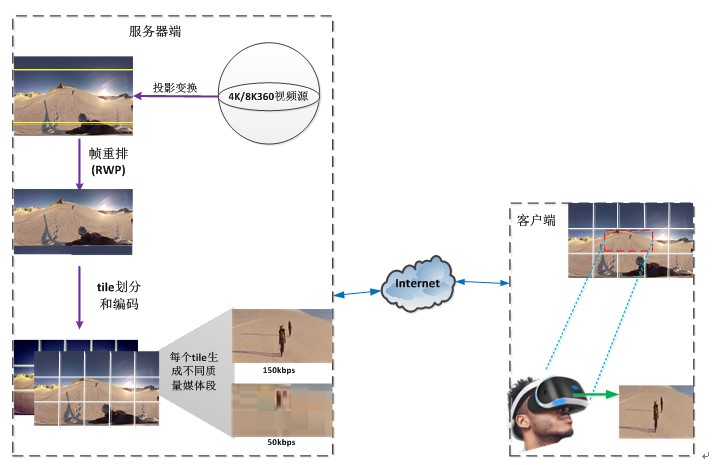

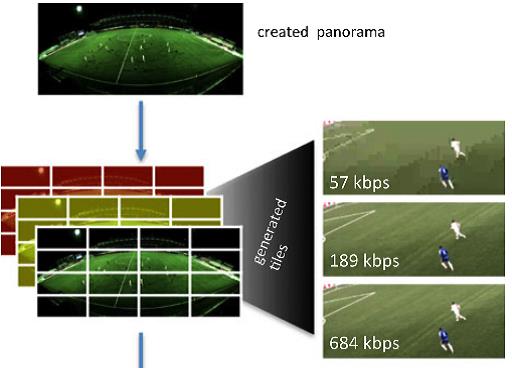

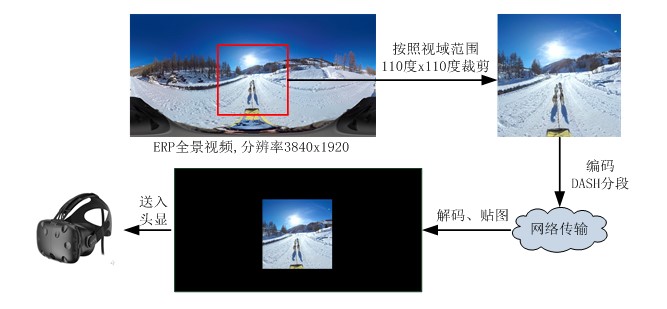

由于人眼视角的限制,同一时刻只能观看360视频的部分区域,因此观看视角优先的传输策略是360视频DASH的核心技术,即根据观看视角分区域下载360视频,从而有效地利用信道带宽。观看视角优先的360视频DASH系统如图4所示。服务器端首先将360视频投影变换为二维平面视频,然后分割成多个区域,对不同区域使用已有的视频压缩标准(如H.265/HEVC)进行编码,使每个区域都具有多个不同质量等级的编码数据,并将区域划分及质量等级等信息在MPD(Media Presentation Description)文件中进行标识。客户端首先通过获取MPD文件了解服务器端存储了哪些视频数据,进而根据信道带宽以及用户的观看行为选择合适的视频数据下载观看。

图4 观看视角优先的360视频DASH系统

相关具体研究方向:

(1)360全景视频映射变换

(2)360全景视频编码

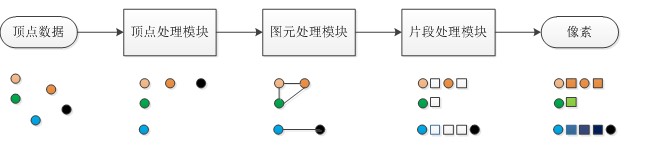

(3)360全景视频渲染

(4)基于Tile的360全景视频传输

(5)360全景视频自适应下载

2、3DOF+

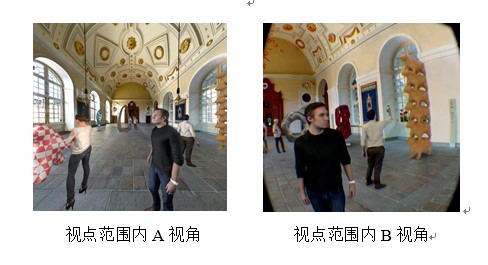

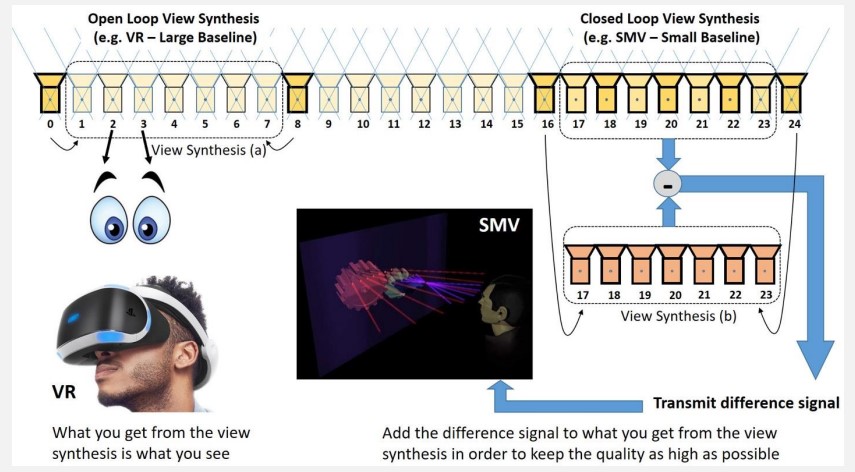

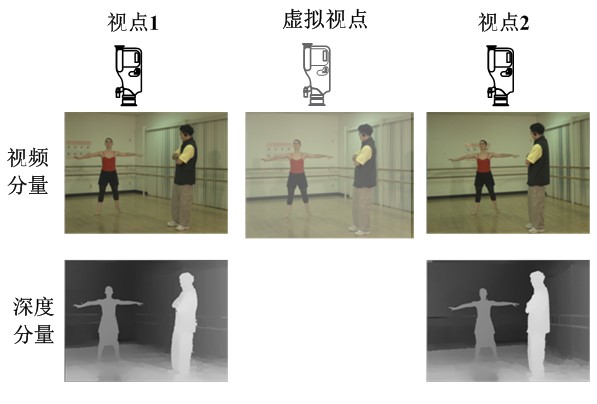

3DoF+ (3 Degrees of Freedom Plus)除了为用户提供三个维度旋转带来的视听体验效果外,还提供向前/向后、向左/向右、向上/向下三个位置维度在有限范围内的头部运动体验(不允许脚步走动)。借助混合现实MR头盔、轻型化HMD等显示设备,可以为用户提供具有立体视差、运动视差、不同角度光照具有变化效果的有限范围内互动3DoF+体验,增加用户的临场感(Presence)和沉浸感(Immersion)。图1给出3DoF+视点范围示意图以及视点范围内两个不同的视角视图,相比3DoF,3DoF+更符合人感知事物的真实过程。此外,3DoF+可以兼容MR/AR,具有广阔的发展前景。

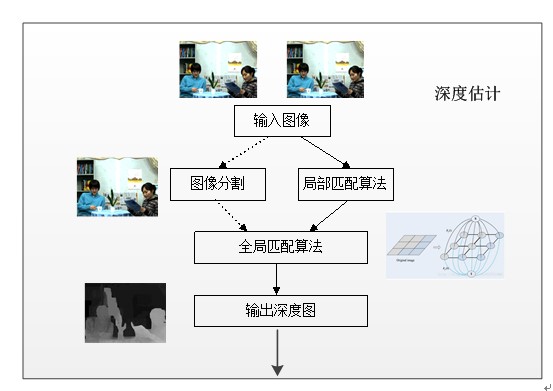

由于采集和存储条件限制,无法获得任意视点内图像信息。采集过程往往会因位移、遮挡等原因造成信息的缺失。在这种情况下,如何有效利用已知视点预测出目标视点图像是3DoF+需要解决的一项重要问题。针对深度未知以及深度已知的场景,可以采用有效的技术手段对目标虚拟视点图像进行合成。

深度估计

虚拟视点合成

VR感知体验逐渐提升的三个阶段

3DoF+与3DoF以及6DoF之间的差异示意图。

3、6DOF——True3D、点云、光场

True3D技术

传统的stereoscopic 3D是利用左右眼之间的视差来让视觉系统产生立体感知的显示技术。与之相区别,True3D技术是一种具有物理景深的立体显示技术,也是多媒体通信与计算机视觉领域最新的研究方向。用户在体验过程中具有三个头部自由度和三个位置自由度(DOF,Degree of Freedom), 可以通过与视觉场景的交互获得更好的临场感和沉浸感。True3D可通过点云重建、光场成像和全息投影等技术实现。目前,实验室已围绕点云、光场等6DOF场景的重要表现形式进行了大量研究,已在点云生成、点云压缩和光场成像等领域获得突出的研究成果。

True3D游戏场景

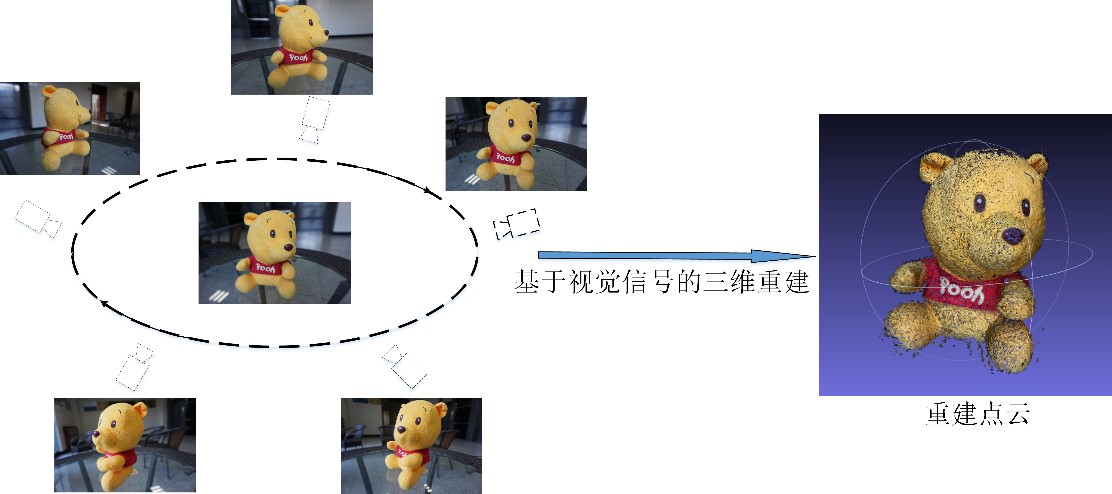

点云生成

点云是指包含了空间坐标、颜色等丰富信息的点的数据集,用于对三维物体和场景进行表示,主要通过三维扫描和基于二维影像的三维重建方式获取。实验室主要研究基于视觉传感器(如相机)的三维点云生成方法,已在视觉SLAM、SfM以及视觉信号与惯性传感器信号融合的点云重建等领域开展研究,提出多种高精度、低复杂度的点云重建算法。

三维重建

基于视觉信号的点云重建示意图

点云压缩

用以表示三维场景的点云数据通常具有数据体量大、数据结构零散等特点。研究高效的点云压缩编码算法成为了True3D领域的重要课题之一。点云压缩编码是去除点云几何、颜色信息的冗余量而获得小体积、高保真点云数据的过程。

目前正在参与最新的点云压缩编码标准GPCC,已有多项提案被接收。

VPCC

GPCC

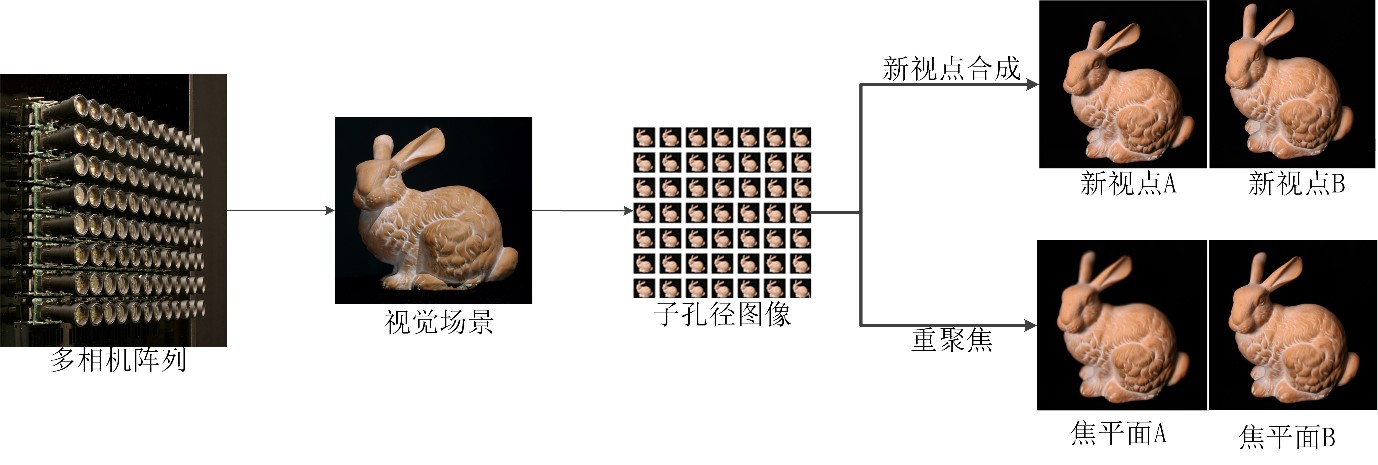

光场成像

光场即空间中任意点发出的任意方向光线的集合。区别于传统成像技术,光场所包含的信息不再是简单的2D像素阵列,而是三维空间中的光线。由于光场包含了一定范围内三维场景中的所有信息,因此我们可以通过计算成像的方式获得不同景深、不同视点的视觉场景。

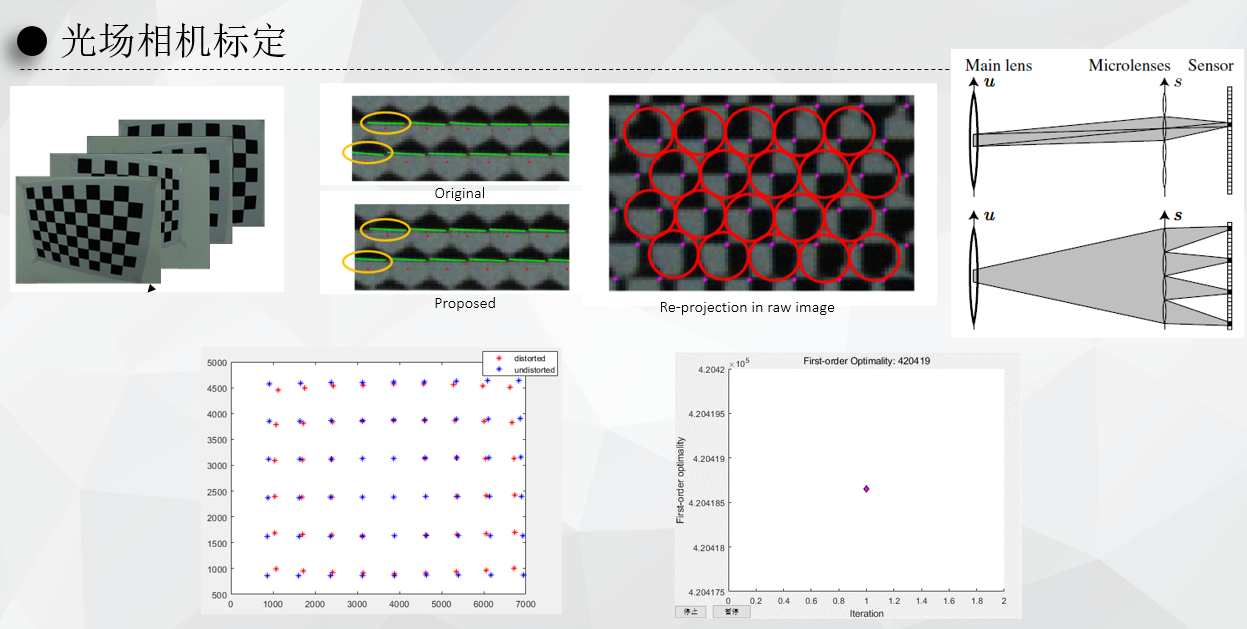

目前主要研究方向:光场相机的内外参标定、基于光场相机的三维重建。

利用光场成像技术实现的新视点合成和重聚焦过程示意图

内参标定

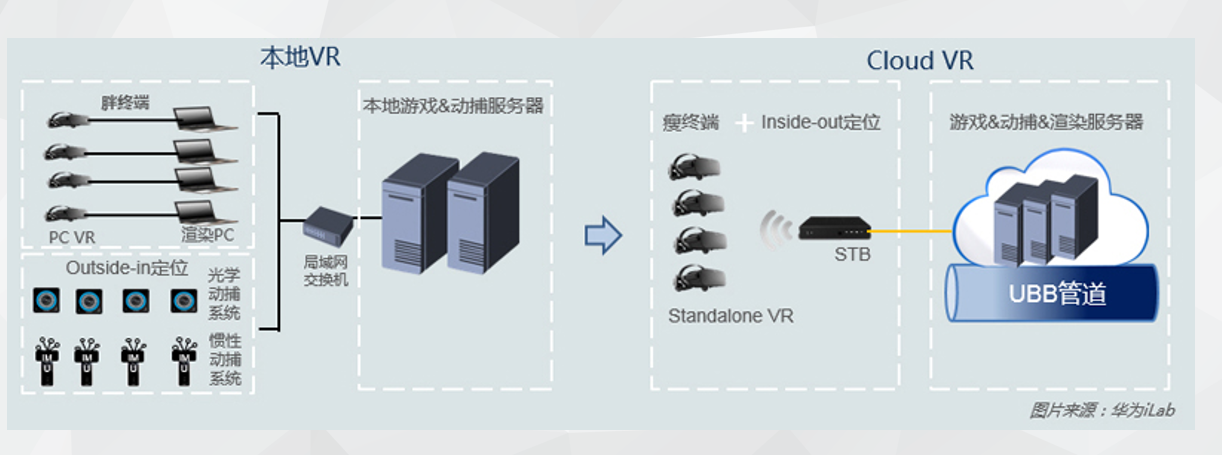

云VR

已经完成了端到端Cloud VR平台,包括游戏模块、服务器、客户端。

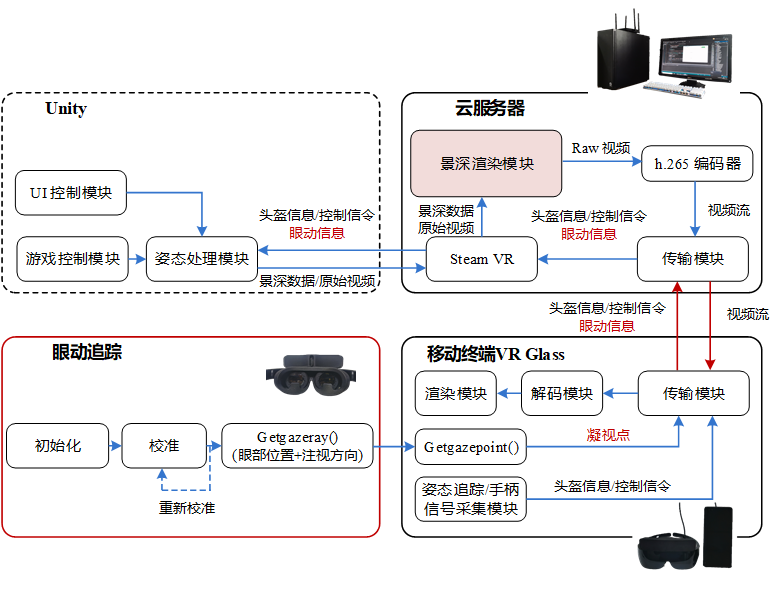

当前主要研究方向:基于视线追踪的云VR、云VR的体验质量监测、面向云VR的视频压缩。

Cloud VR

基于视点追踪的VR系统

4、基于深度学习的视频处理及编码

当前主要方向,基于深度学习的图像处理、视频质量优化、智能识别

质量增强:超分、去模糊、去雾等

基于深度学习的图像编码

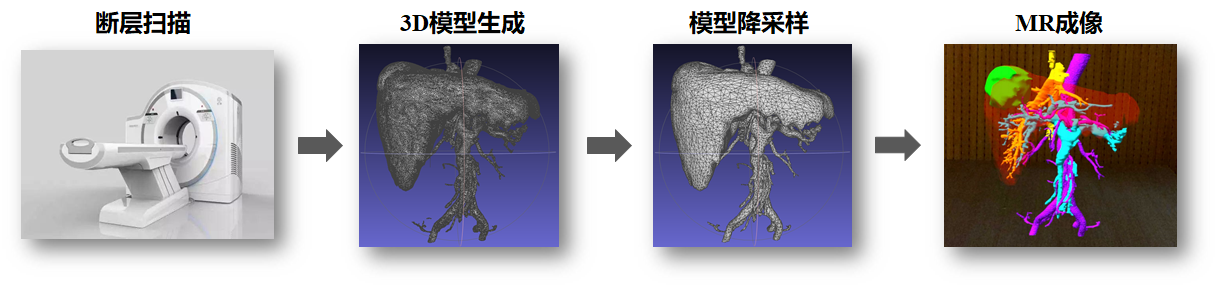

基于AR的肝脏手术引导

传统研究方向

1、相机前处理

相机的前处理技术是保证拍摄视频高质量的关键,如自动聚焦、防抖。这款量产摄像机的关键前处理技术(自动白平衡、自动曝光、自动聚焦)是我们开发的。

2、相机后处理

相机的后处理技术可以大大提高相机的使用性能,背景行人去除可以轻松留念。

3、视频压缩

视频压缩可以有效降低视频的数据量,累计向ISO/ITU的视频压缩标准提出30多项标准化提案,2006年有两项提案被ISO/ITU的国际视频压缩标准H.264接收。目前正在参与新的国际标准VVC/H.266,有多项技术提案被接收。

目前的主要研究方向:VVC/H.266的率失真优化、快速算法,基于深度学习的图像、视频压缩。

264中被接收的方案

VVC/H.266标准中被接收的提案之一

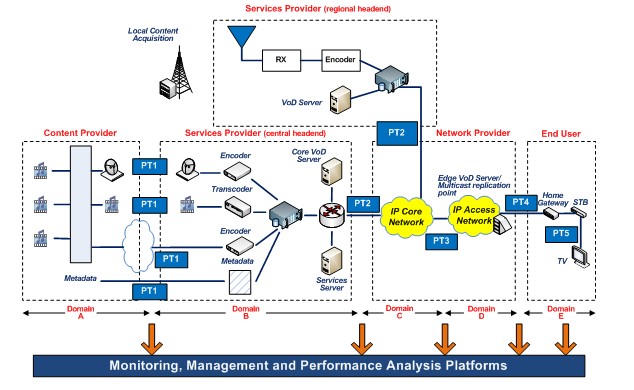

4、视频质量监测

视频质量监测是保证视频通信质量的关键环节,在网络视频流的质量评估领域具有国际领先水平,核心技术被国际标准ITU-T P.1201、P.1203、G.1071采纳。

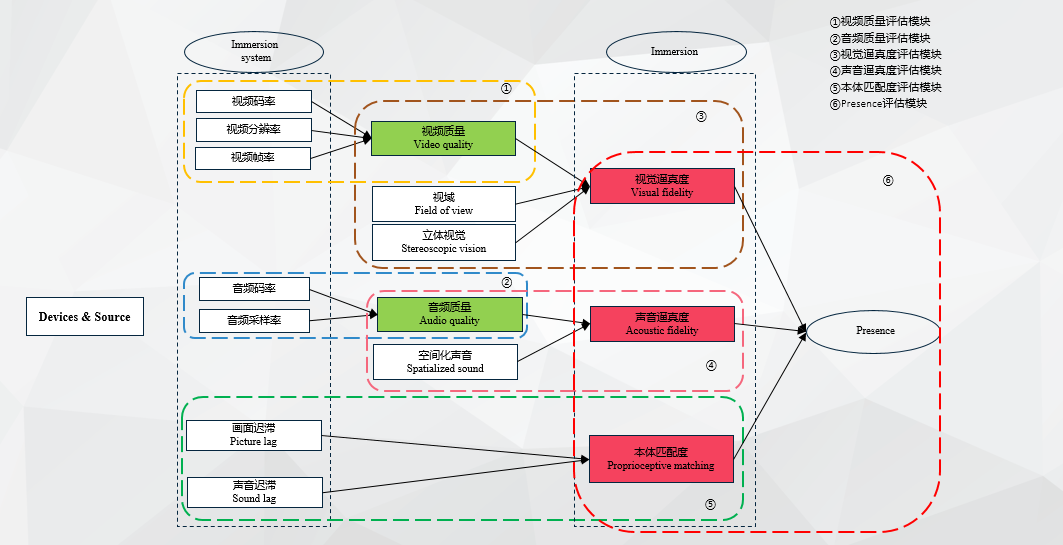

当前的主要研究方向:云VR的体验质量监测设备(黑边、时延、抖动等)、监测系统,VR临场感体验质量,VR渲染美学质量评价。

质量监测

VR临场感体验质量评价

Cloud VR 质量评测系统